Kiedy na rynku muzycznym pojawiły się pierwsze nagrania stereofoniczne, wydawało się, że dokonała się wielka rewolucja technologiczna, zapewniająca odbiór dźwięku na najwyższym poziomie. Wymienia się zresztą kilka kluczowych dat, jak rok 1925 (pierwsza stereofoniczna audycja radiowa BBC) czy 1938 (pierwsze celowo wykonane stereofoniczne nagranie muzyczne) – co wskazuje, że standard jest już stosunkowo stary. I nadal dominujący w branży, choć wciąż pracuje się nad podniesieniem poziomu doznań słuchaczy.

Kwestia przestrzeni w muzyce – czy w szerszym rozumieniu we wszystkich nagraniach dźwiękowych (jak np. ścieżki filmowe) – od początku odgrywała istotną rolę w pracy realizatorów. Z jednej strony starano się reprodukować wszelkie cechy wielowymiarowego środowiska akustycznego, zaś z drugiej, wykreować elektronicznie efekty, które w naturze nie występują. I szybko okazało się, że dwa kanały nie dają pełni możliwości – pojawiły się realizacje wielokanałowe, zarówno w postaci nagrań, jak i nagłośnienia koncertowego, a także różne formaty, standardy zapisu. Współcześni słuchacze oraz osoby zajmujące się tym zagadnieniem zawodowo wciąż spotykają się z jakimiś nowościami, często anonsowanymi jako rewolucja i skok jakościowy. Dźwięk 3D, 8D (i coraz większe liczby towarzyszące literze D), ambisoniczny, binauralny, 360 Reality Audio, Dolby Atmos itd. Niekiedy różne terminy opisują w istocie to samo, a z perspektywy słuchacza różnic w odbiorze nie ma, tym niemniej nowe technologie i standardy stawiają dodatkowe wymagania przed realizatorami, chcącymi dotrzymać kroku postępowi. O co w tym wszystkim chodzi? Najogólniej mówiąc, o uzyskanie wrażenia zanurzenia w przestrzeni dźwiękowej, czyli o dźwięk immersyjny, o wrażenie otoczenia przez zdarzenia akustyczne. Przy czym mamy do czynienia zarówno z wiernym odwzorowaniem rzeczywistego środowiska, jak i z kreowaniem efektów w naturze nieznanych. Z punktu widzenia osób zajmujących się realizacją nagrań można wskazać dwa podstawowe etapy – dokonanie samej rejestracji i postprodukcji (względnie transmisji na żywo) w taki sposób, by źródła dźwięku (w domyśle np. instrumenty) miały swoją lokalizację przestrzenną, a także takie zakodowanie informacji dźwiękowej, by została ona właściwie odebrana przez słuchacza. Ewolucja kanałów dystrybucji muzyki, a także zmiany w postawach samych odbiorców doprowadziły do tego, że obecnie zdecydowana większość osób słucha muzyki w Internecie, względnie stamtąd ją pozyskuje w postaci plików. Podobnie zresztą jest z treściami wideo, filmami, transmisjami. Czy ten fakt ma wpływ na pracę realizatorów, kompozytorów, muzyków? Mogłoby się wydawać, że tworzenie muzyki od strony technicznej cały czas polega na tym samym, bez względu na sposób jej dystrybucji, ale sprawa jest dużo bardziej skomplikowana. Należy tu mieć na uwadze szereg kwestii, jak choćby to, na jakim sprzęcie jest ona dziś najczęściej słuchana, w jaki sposób, w jakich formatach etc. Paradoksalnie, choć mamy do dyspozycji coraz bardziej zaawansowaną technologię, coraz więcej osób wybiera formaty skompresowane, odtwarza z urządzeń mobilnych za pomocą słuchawek pośledniej jakości. To oczywiście ich wybór, ale też starą i doskonale znaną prawdą jest ta, że nie jest sztuką wyprodukować dźwięk, który zabrzmi doskonale na referencyjnym sprzęcie najwyższej jakości – ale jest nią stworzenie takiego, który zabrzmi znakomicie na każdym i w każdych warunkach.

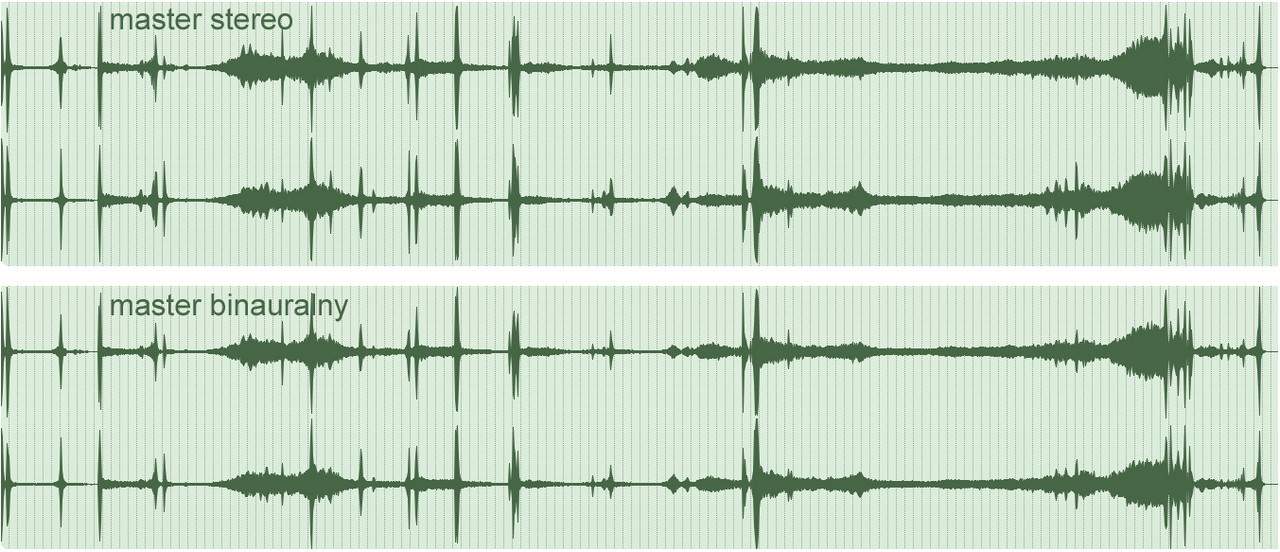

Porównanie plików audio stereo (górny wykres) i binauralnego (dolny), oba są mixdownem tego samego mastera wielokanałowego (utworu muzycznego), jednak w każdym wypadku zastosowano różne wtyczki do konwersji na dwa kanały.

Z technicznego punktu widzenia istotniejszą kwestią jest to, że muzyka dostępna w Internecie pozwala na wykorzystanie wielu nowych standardów, formatów, które nie były dostępne w epoce, kiedy niepodzielnie królowały nośniki fizyczne. W tych nowościach najczęściej chodzi właśnie o dźwięk immersyjny, o lepsze oddanie trójwymiarowej przestrzeni akustycznej. I tym zagadnieniem zajmę się w niniejszym artykule, wprowadzając czytelników w to, co oferują nowe rozwiązania i jak sobie z nimi radzić w praktyce. Oczywiście, w muzyce nadal dominują realizacje stereofoniczne i to się raczej nie zmieni, co wynika z naszych przyzwyczajeń, minimalnych wymagań sprzętowych i możliwości odsłuchu zarówno z głośników, jak i słuchawek. Jednak obok nich zaczynają się coraz bardziej przebijać inne, które podnoszą słuchanie muzyki (ale nie tylko) na inny poziom. Niektóre zresztą nie są niczym nowym (jak dźwięk binauralny), inne jednak wymuszają na realizatorach zastosowanie nowych narzędzi w procesie tworzenia. Powiedzmy także, że mamy do czynienia ze standardami, które są przeznaczone do reprodukcji za pomocą głośników (odpowiednio skonfigurowanych systemów) i słuchawek, jak i takimi, które dedykowano wyłącznie słuchawkom. Zresztą ta forma odsłuchu jest coraz bardziej popularna, co wiąże się z rozwojem wspomnianych technologii i postępującymi za nimi zmianami w nastawieniu odbiorców. Choć pod względem jakości dźwięku, wrażeń przestrzennych i wielu innych kwestii nic nie przebije wysokiej klasy systemów głośników, to jednak ich nabycie i instalacja w warunkach domowych jest często poza zasięgiem przeciętnego odbiorcy, a słuchawki są rozsądną i znacznie dostępniejszą alternatywą. I tu niezbędna jest istotna uwaga: dźwięk w słuchawkach zawsze będzie inny niż płynący z głośników, co wynika z wielu – nie zawsze oczywistych – kwestii, o których realizator musi pamiętać i uwzględniać je w swojej pracy. Bowiem gdy słuchamy dowolnego materiału audio z głośników, w procesie tym zawsze uczestniczy para uszu i uzyskana w ten sposób informacja jest przetwarzana przez mózg, by można zlokalizować położenie i odległość poszczególnych źródeł czy rozpoznać ich ruch. W przypadku słuchawek mamy do czynienia z akustyczną separacją uszu od siebie – każde słyszy tylko materiał reprodukowany w danym nauszniku. Skupiając się wyłącznie na kwestii percepcji przestrzeni, w słuchawkach niekiedy ma się wrażenie szerszej bazy, bardziej radykalnego panoramowania (zwłaszcza w porównaniu z materiałem stereo z głośników) czy też wyrazistszych i głębszych pogłosów. I tak naprawdę optymalnym rozwiązaniem byłoby, gdyby nawet w przypadku materiałów stereofonicznych producenci tworzyli osobne miksy słuchawkowe (binauralne).

Inne porównanie plików audio stereo (górny wykres) i binauralnego (dolny), tym razem jest to sygnał testowy, krótki impuls, który w oryginalnym materiale przestrzennym krąży po okręgu. Jak widać wyraźnie, wersja stereofoniczna istotnie różni się od binauralnej, choć obie są mixdownem tego samego źródła.

Gdy mówimy o dźwięku przestrzennym, możemy wyróżnić dwa zasadnicze kierunki – starszy, ale nadal aktualny, oparty na kanałach projekcji jak kwadrofoniczny, 5.1, oktofoniczny i inne. W wynikowym materiale poszczególne kanały odpowiadają konkretnym głośnikom; innymi słowy – każdy z nich ma swój dedykowany plik audio. Cechą tych standardów jest to, że nagrania w nich zrealizowane muszą być odtwarzane za pomocą konkretnego systemu nagłośnieniowego, ale jednocześnie nie wymagają one kodowania i odkodowywania w procesie reprodukcji – wystarczy dowolne narzędzie do odtworzenia plików audio. Z tego też względu doskonale sprawdzą się w warunkach koncertowych, gdzie także są powszechnie używane (np. w muzyce elektroakustycznej, ale nie tylko). Próby wprowadzenia na rynek konsumencki przyniosły sukces raczej w branży filmowej (najpierw płyty DVD, aktualnie serwisy streamingowe), w muzyce zbytnio się nie przebiły (DVD-Audio czy SACD pozostały ekskluzywnymi i niszowymi formatami). Tym niemniej można w Internecie znaleźć muzykę dystrybuowaną w wersji 5.1, a takie realizacje cały czas powstają i w pewnych gatunkach są dość powszechne. Drugi kierunek rozwoju bazuje na koncepcji obiektowego dźwięku przestrzennego – jednym z pierwszych przykładów jest dźwięk ambisoniczny, rozwijany już od lat 70., co prawda bez sukcesów komercyjnych (na rynek konsumencki się nie przebił), ale obecny w realizacjach elektroakustycznych, instalacjach audio, VR itp. Odegrał także istotną rolę w opracowaniu najnowszych standardów dźwięku obiektowego, jak Dolby Atmos czy 360 Reality Audio. O co chodzi w tej koncepcji? Tutaj pliki audio nie odpowiadają konkretnym kanałom, ale obiektom i zawierają w sobie metadane określające ich lokalizację w sferycznej przestrzeni akustycznej. Pomijając techniczną złożoność, konieczność kodowania i dekodowania informacji dźwiękowej, zaletą tych standardów jest to, że ten sam materiał może być reprodukowany za pomocą dowolnego systemu nagłośnieniowego, który spełnia przynajmniej minimalne wymogi (liczba i rozmieszczenie głośników). Dodajmy także, że w każdym wypadku standardów kanałowych czy obiektowych, materiał może być konwertowany do postaci binauralnej przeznaczonej do odsłuchu słuchawkowego i zachowującej immersyjny charakter dźwięku.

Przykład wysokiej klasy profesjonalnego mikrofonu binauralnego

Gdy mówimy o samej realizacji materiału muzycznego, osoby mające już doświadczenie z dźwiękiem przestrzennym, wielokanałowym powinny sobie poradzić z dowolnym standardem – będzie to bowiem kwestia opanowania nowych narzędzi, technologii (czasem może i dość czasochłonna), ale sama idea trójwymiarowej przestrzeni akustycznej jest im już znana. Zasady dotyczące psychoakustyki, estetyki muzycznej i wielu innych są ogólne, zaś konkretna technologia to jedynie sposób praktycznej realizacji określonego projektu. Trudniejsze zadanie stanie przez tymi, którzy dotąd pracowali wyłącznie z materiałem stereofonicznym. Różnica między nim a przestrzennym jest kolosalna i nie polega wyłącznie na tym, że mamy większe możliwości lokowania i przemieszczania źródła dźwięku. Zagadnienia praktyczne dotyczące takich realizacji nie są przedmiotem tego artykułu, tym niemniej należy o nich wspomnieć. Z doświadczenia wiem, że twórcom przechodzącym od stereofonii do dźwięku przestrzennego wiele kwestii sprawia na początku problemy – nie rozumieją dlaczego coś w teorii dobrze zaplanowanego w praktyce zabrzmi zupełnie inaczej albo w ogóle nie przyniesie żadnego efektu. Dlaczego pewne typy dźwięków dla uzyskania lepszego rezultatu powinny zachować statyczne pozycje, a inne mogą z powodzeniem być dynamicznie panoramowane. Dlaczego zmienia się rola i znaczenie pogłosu. A to tylko pierwsze z brzegu przykłady. Częstym grzechem początkujących jest też pragnienie wprawienia w ruch wszystkiego, co się da, bo przecież tak ekscytująco brzmi, gdy dźwięk krąży wokół słuchacza. Otóż niekoniecznie. Warto pamiętać, że utwór muzyczny nie jest – poza oczywistymi wyjątkami – formą demonstracji możliwości technologii, ale ma sprawić słuchaczowi przyjemność i nie zamęczać przesytem użytych środków.

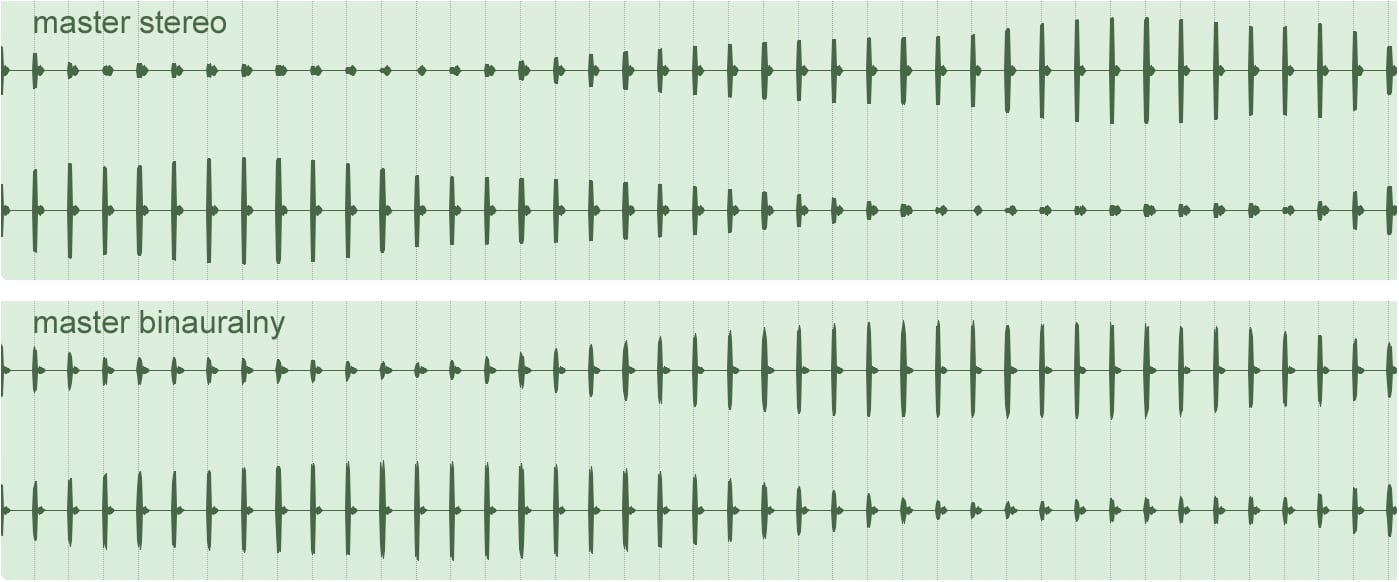

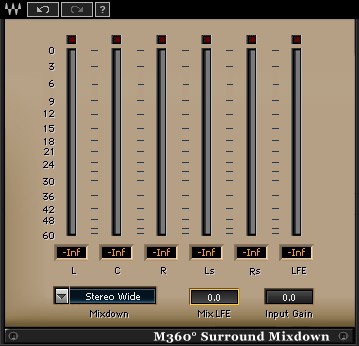

Wtyczka do konwersji (mixdownu) materiału wielokanałowego do stereo

Dźwięk binauralny

W szerokim rozumieniu jest to taki typ dwukanałowego materiału dźwiękowego, który wykorzystując właściwości naszego słyszenia (a także budowę ucha i wpływ głowy na odbiór fali akustycznej) tworzy iluzję otaczającej słuchacza przestrzeni. Od razu dodajmy, że do właściwego odbioru niezbędne jest korzystanie ze słuchawek. Tradycyjny zapis stereofoniczny i binauralny nie są kompatybilne. Dzieje się tak dlatego, że w przypadku tego drugiego tworzone są osobne informacje dla ucha lewego i prawego, zatem niezbędna jest ich separacja akustyczna. Co nie zachodzi w przypadku odsłuchu za pomocą głośników. Czy to zatem oznacza, że ta forma odbioru materiału binauralnego nie ma sensu? Odpowiedź nie jest jednoznaczna. Po pierwsze – z oczywistych względów nie usłyszymy wówczas immersyjnego charakteru dźwięku, a jedynie dwukanałowy materiał, jakby nieco dziwnie wyprodukowane stereo. Ze względu na przesłuchy międzykanałowe odbiór będzie zakłócony, zwłaszcza zaś środek pola. Na marginesie można jedynie zastanawiać się, czy dla sporej grupy słuchaczy będzie to w ogóle mieć znaczenie, choćby ze względu na niewłaściwą konfigurację systemu audio czy też traktowanie muzyki jako tła do innych czynności. Ale to nie jest już przedmiotem naszych rozważań. Natomiast istnieją techniczne sposoby konwersji materiału binauralnego za pomocą narzędzi (filtrów) do eliminacji negatywnego wpływu przesłuchów międzykanałowych, choć można zapytać o celowość takich zabiegów. Znacznie popularniejsze jest bowiem oprogramowanie konwertujące w drugą stronę, o czym szerzej potem. Warto jeszcze dodać, że terminem binauralnych określa się wszystkie standardy dwukanałowe przeznaczone do odbioru w słuchawkach i bazujące na tworzeniu osobnych informacji dla każdego ucha, jak choćby dźwięk 3D, czy 8D – aktualnie bardzo popularny na YouTubie czy głównych serwisach streamingowych.

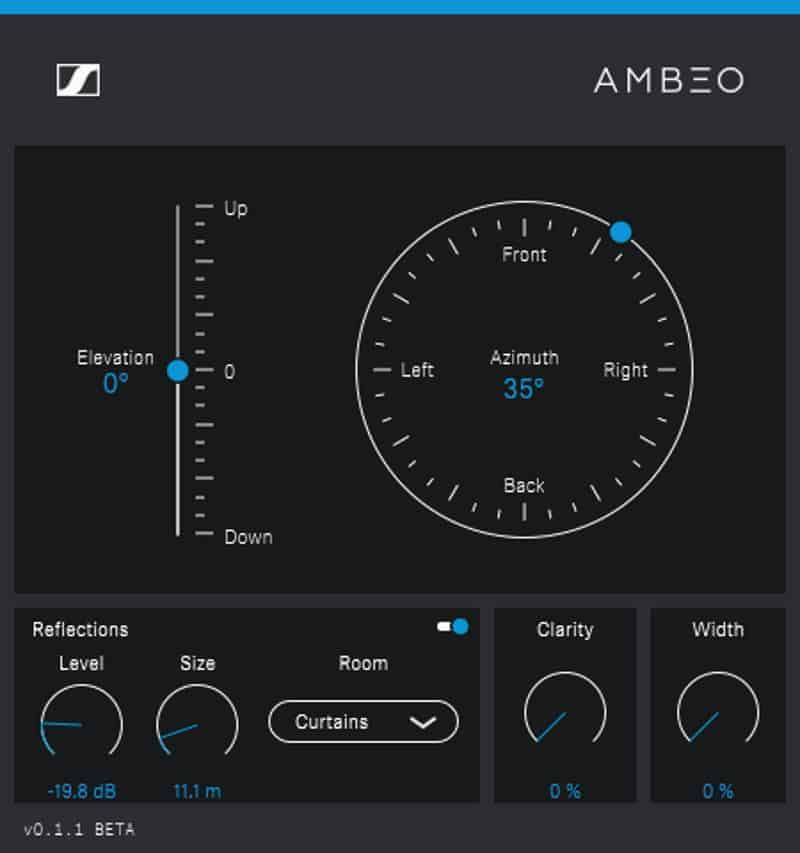

Sferyczny panner binauralny w postaci wtyczki VST

Gdy mówimy o dźwięku binauralnym, koniecznie trzeba wspomnieć o węższym zagadnieniu, jakim jest nagrywanie binauralne – warto o tym pamiętać i obu kwestii, choć ściśle ze sobą związanych, nie uznawać za synonimy i ich ze sobą nie mylić. Jako technika nagrywania nawiązuje do koncepcji tzw. sztucznej głowy i jest realizowana – w swojej klasycznej postaci – za pomocą pary mikrofonów skonstruowanych i połączonych w taki sposób, że naśladują budowę uszu, a także sam proces słyszenia i odbioru fali dźwiękowej przez błonę bębenkową. Uzyskany w ten sposób materiał odwzorowuje zatem to, jak dźwięki słyszy człowiek i jak lokalizuje je w otaczającej przestrzeni. Na rynku dostępnych jest wiele modeli takich mikrofonów, ich ceny są także dość różne – podobnie jest z jakością. Typowymi przykładami, o bardzo uniwersalnych (zdecydowanie profesjonalnych) zastosowaniach są produkty firmy 3DIO, jak Free Space czy Omni. Mają dość charakterystyczny wygląd, z silikonowymi replikami małżowin usznych i oferują znakomity, bezkompromisowy dźwięk. Niestety topowe modele są (co zrozumiałe) bardzo drogie. Tańszą alternatywą do mniej wymagających aplikacji jest np. Roland CS-10EM, system monitorów dousznych z mikrofonami. Inne to m. in. Sound Professionals SP-TFB-2, Sonic Presence SP15C czy Sennheiser AMBEO Smart Headset. Jako ciekawostkę dodam, że duńska firma Bruel & Kjaer stworzyła specjalny system HATS (Head And Torso Simulation), służący przede wszystkim do testów i pomiarów akustycznych, który składa się ze specjalnego manekina, odwzorowującego uszy, jamę ustną, głowę i korpus – wszystko w celu maksymalnego zbliżenia uzyskanego rezultatu do tego, jak falę akustyczną odbiera człowiek.

Wtyczka do konwersji (mixdownu) materiału wielokanałowego do binauralnego

Nagrywanie binauralne jest bardzo ciekawą techniką, pozwalającą na uzyskanie wielu bardzo wiarygodnie brzmiących efektów czy też naturalnego dźwięku immersyjnego w realizacjach dwukanałowych. Znajduje zastosowanie w przemyśle filmowym, muzycznym, technologii VR, grach komputerowych itp. Ma oczywiście swoje ograniczenia i nie może być wykorzystane w każdej sytuacji. Gdy mowa o realizacjach muzycznych, tutaj zdecydowana ich większość powstaje tradycyjnymi metodami, czy to za pomocą indywidualnego omikrofonowania instrumentów, nagrań liniowych, czy też poprzez syntezę dźwięku – w celu uzyskania poszczególnych ścieżek, następnie miksowanych i umieszczanych w wirtualnej przestrzeni akustycznej za pomocą dedykowanych narzędzi. Można zaryzykować tezę, że w przypadku muzyki produkcja materiału binauralnego jest jednym z docelowych rezultatów, ale raczej rzadko jedynym. Byłoby to bowiem istotne ograniczenie zasięgu odbioru takiego produktu, zatem miks binauralny traktuje się jako jeden z alternatywnych wobec standardowego stereofonicznego czy nawet wielokanałowego. I tu warto podkreślić jedną z zalet takiej postaci materiału dźwiękowego, ale z punktu widzenia realizatora bardzo cenną – otóż zawsze możliwa jest konwersja nagrania w innym standardzie na zapis czy też transmisję binauralną. Jakkolwiek istnieją narzędzia (np. wtyczki) do panoramowania binauralnego, które pozwalają na tworzenie takiego miksu już od podstaw, jest także szereg rozwiązań (często w postaci wtyczek VST, AU, AAX, RTAS), które służą do konwersji gotowego materiału na binauralny. Oczywiście, najlepsze efekty uzyska się, wykorzystując jako wejście nagranie (czy transmisję, bowiem proces może zachodzić w czasie rzeczywistym) wielokanałowe, z przestrzenną lokacją różnych źródeł czy ich ruchem sferycznym (zatem nie tylko lewy – prawy i przód – tył, ale także góra – dół), co w efekcie da immersyjny dźwięk dwukanałowy w słuchawkach. W tym miejscu należy podkreślić, że czym innym jest tzw. mixdown materiału wielokanałowego do postaci stereo, zaś czym innym konwersja do binauralnej. Te dwa zadania realizuje się za pomocą innych narzędzi – w pierwszym wypadku mamy do czynienia z sumowaniem (miksowaniem) kanałów w określony sposób, by z pliku wielokanałowego uzyskać stereofoniczny, do odsłuchu zarówno poprzez głośniki, jak i w słuchawkach. Dostępne są zwykle różne algorytmy, pozwalające np. na uzyskanie poszerzonej bazy, zachowanie pożądanej pozycji źródeł dźwięku względem środka itp. W drugim wypadku – choć również możemy mówić o procesie sumowania kanałów, dochodzi do takiego zakodowania materiału dźwiękowego (używa się tu np. określenia HRTF, od Head Related Transfer Function), że powstają osobne informacje dla każdego ucha i finalnie materiał binauralny, który w określonym stopniu pozwala cieszyć się wrażeniem przestrzeni.

Wtyczka do konwersji (mixdownu) materiału ambisonicznego do binauralnego

Zapewne w tym miejscu część czytelników chciałaby zapytać, jak realistyczna, wiarygodna jest ta iluzja immersyjnego dźwięku i czy odwzorowuje wiernie to, co zawarte jest w materiale wielokanałowym, zatem przestrzenną lokalizację źródeł, ruch sferyczny itd. Nieprzypadkowo używamy tu słowa „iluzja”, bowiem jest to (o czym była już mowa) w istocie metoda wykorzystująca zjawiska psychoakustyczne do przekonania naszego mózgu, że zdarzenie dźwiękowe znajduje się w określonym miejscu przestrzeni, choć tak naprawdę go tam wcale nie ma. Czy dźwięk binauralny daje takie same wrażenia jak słuchanie realizacji wielokanałowej z odpowiednio skonfigurowanego systemu głośników? Nie, bo to po prostu niemożliwe. Ale generalnie jest on wyraźnie bardziej przestrzenny, wielowymiarowy niż tożsame muzycznie nagranie stereofoniczne odbierane w słuchawkach. Iluzja lokacji źródeł, ich trójwymiarowego ruchu jest dość przekonywująca – w ramach tych konkretnych warunków odsłuchu.

Realizacje binauralne wykazują wiele zalet, dzięki którym mają szansę na dalszy rozwój i popularyzację, pomimo tego, że sama koncepcja nie jest nowa. Wymienię zatem te najważniejsze:

- Mogą mieć wiele różnych postaci, być dystrybuowane na każdym nośniku fizycznym, czy też jako pliki audio do pobrania z Internetu, albo do odsłuchania w serwisach streamingowych, czy jako transmisja na żywo (z koncertu, spektaklu itd.).

- Nie wymagają dużego pakietu danych, rozmiar pliku jest taki sam jak w przypadku realizacji stereo.

- Nie wymagają specjalnych narzędzi po stronie odbiorcy, do odsłuchu wystarczą słuchawki.

- Do postaci binauralnej można łatwo konwertować materiał zrealizowany w innym standardzie, wielokanałowy 5.1, oktofoniczny itp. Istnieje wiele narzędzi dedykowanych temu zadaniu, a ich używanie nie wiąże się z jakimś szczególnie trudnym do opanowania zakresem wiedzy – poza standardowymi ustawieniami po stronie użytkownika, sam proces kodowania odbywa się automatycznie.

- Ze względu na dostępność narzędzi do konwersji, kompozytor, muzycy czy realizator nagrań nie musi od podstaw przygotowywać wyłącznie miks binauralny, a jedynie traktować go jako jedną z wersji gotowego materiału. Jest to także przydatne w przypadku realizowanych na żywo transmisji z koncertów, gdy można przygotować wyjściowy miks wielokanałowy, który następnie będzie konwertowany alternatywnie do stereo i binauralnego, dając słuchaczom możliwość wyboru.

Choć mówię tu o czymś, co liczy sobie już wiele lat, ponadto cały czas funkcjonuje gdzieś w tle, jakby za plecami klasycznej stereofonii, dźwięk binauralny ma przed sobą przyszłość – w istocie bowiem tą nazwą można objąć każdą formę dystrybucji materiału dwukanałowego, przeznaczonego do odsłuchu w słuchawkach. Będą się pojawiać nowe standardy, metody tworzenia realistycznie brzmiącego dźwięku immersyjnego, a z oczywistych względów większość odbiorców będzie ich doświadczać właśnie w słuchawkach.

Przykład wtyczki do tworzenia materiałów binauralnych 8D

Dolby Atmos

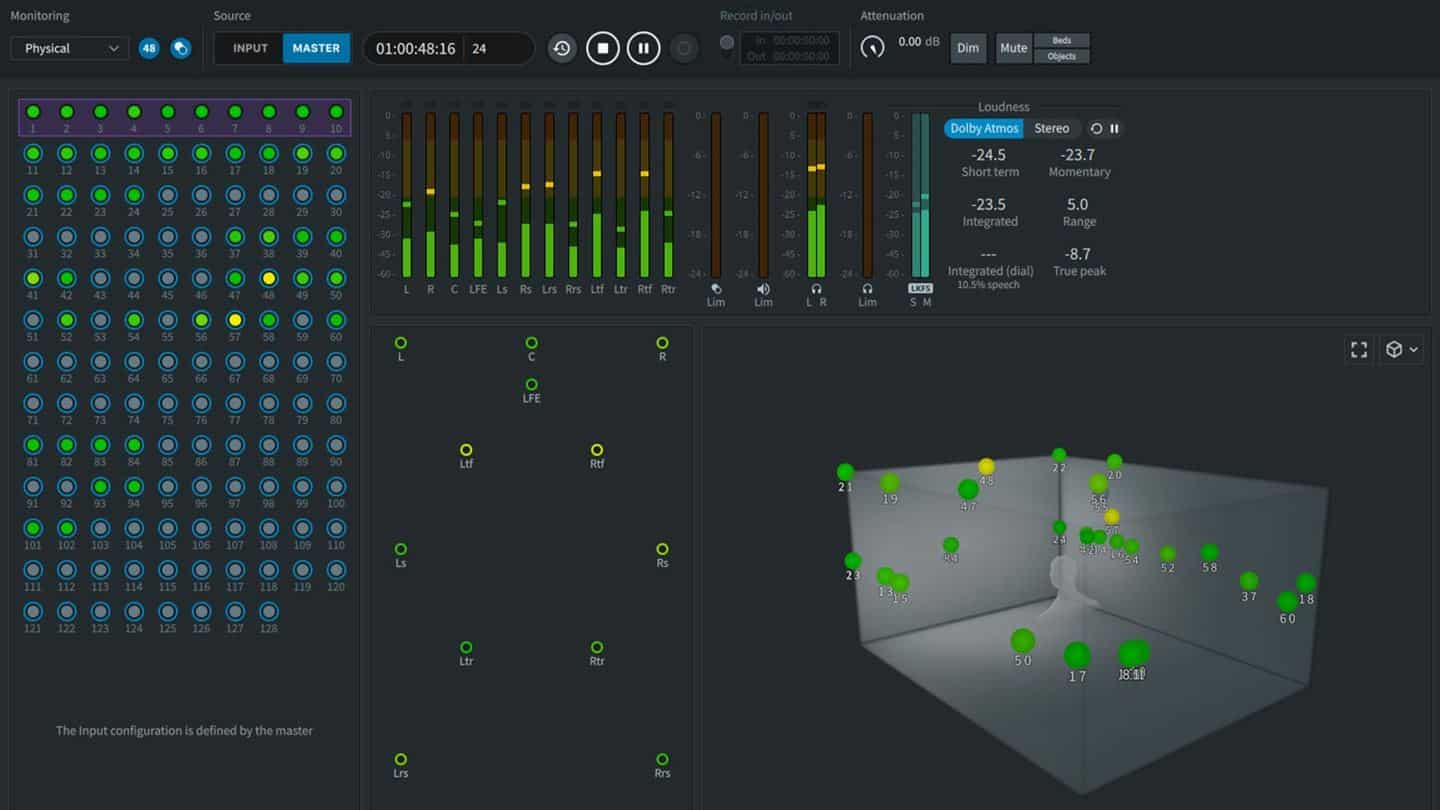

Standard po raz pierwszy został zaprezentowany komercyjnie w 2012 roku, zaś od 2014 roku na rynku dostępne są kompatybilne z nim urządzenia konsumenckie – przede wszystkim zestawy kina domowego. Pojawił się także w urządzeniach mobilnych, nawet tak popularnych produktach, jak smartfony (tu do odbioru w słuchawkach). Od razu powiedzmy sobie, że jest to rozwiązanie dedykowane przede wszystkim rynkowi filmowemu, wideo, w pewnym stopniu także VR itp. Ponieważ pojawiają się jednak już produkcje muzyczne w tym standardzie, co prawda bardzo rzadkie, ale jednak – są nawet także dystrybuowane w Internecie – poświęcę mu chwilę uwagi. Dolby Atmos (konkurencyjny wobec DTS:X) jest technologią wykorzystującą dźwięk obiektowy do lokowania źródeł w trójwymiarowej przestrzeni, która jest następnie reprodukowana za pomocą odpowiedniego systemu głośników – takie podejście powoduje, że materiał zrealizowany w tym standardzie może być odtwarzany w różnych konfiguracjach nagłośnienia. Bardzo rozbudowanych, kinowych, jak i mniejszych, konsumenckich. W tym drugim wypadku wymagania sprzętowe są i tak wyższe niż doskonale znanego 5.1, konieczne są dodatkowe głośniki, co oczywiście dla większości potencjalnych odbiorców stanowi poważny problem – także ze względu na referencyjne rozstawienie całości – niewielu może sobie pozwolić na przeznaczenie osobnego pomieszczenia do oglądania filmów czy odsłuchu muzyki. W tym miejscu trzeba mieć na uwadze kilka kwestii – Dolby Atmos został stworzony w pierwszej kolejności do zastosowań profesjonalnych, kinowych, zatem właśnie dużych instalacji. Lista obiektów posiadających odpowiedni sprzęt zresztą stale rośnie. Wejście standardu na rynek konsumencki (przede wszystkim właśnie filmowy) było naturalną konsekwencją tego faktu – zresztą wiodące serwisy streamingowe, jak Netflix, HBO, Amazon Prime, wprowadziły do swojej oferty materiały z takim dźwiękiem. Co wiąże się także z przesuwaniem preferencji odbiorców właśnie w kierunku takich serwisów, znacznie przyspieszonym przez pandemię, okresowe zamykanie kin i inne ograniczenia.

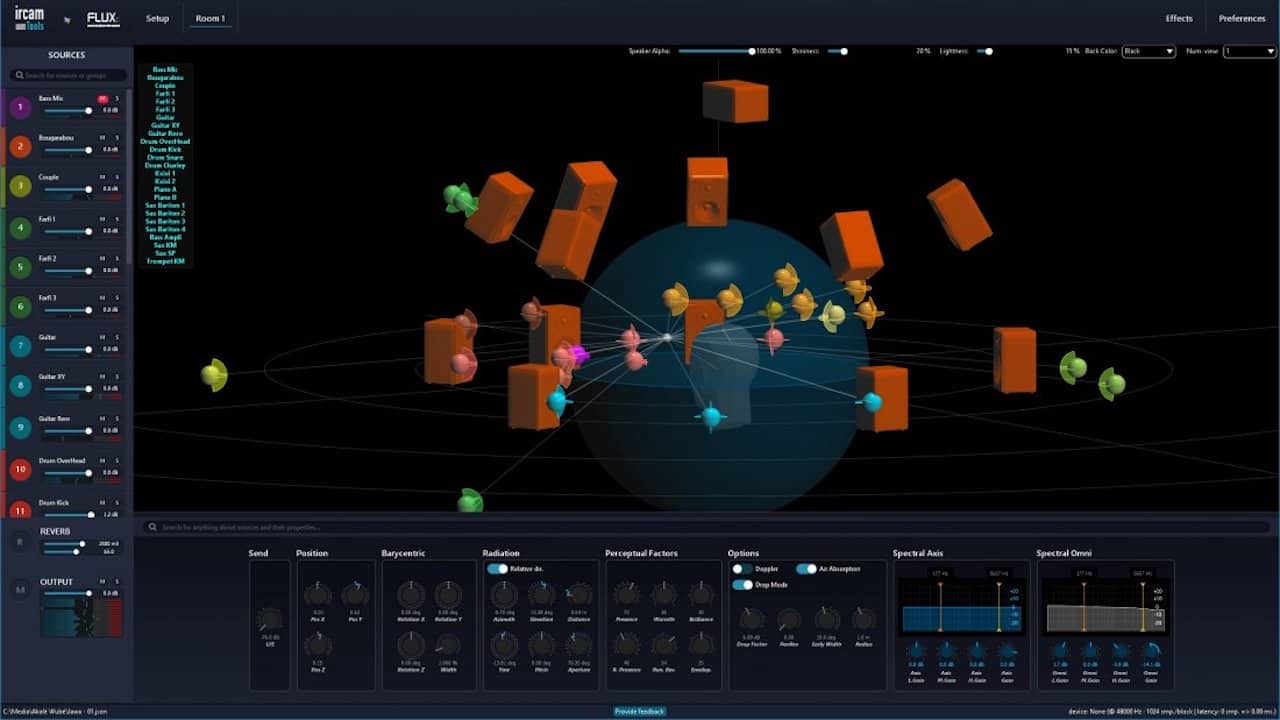

Zaawansowane narzędzie (wtyczka) do przestrzennej lokacji źródeł dźwięku, kompatybilna z Dolby Atmos

Dolby Atmos umożliwia odsłuch w słuchawkach (w urządzeniach mobilnych np. wymagana jest specjalna aplikacja, Dolby Access), aczkolwiek zasadniczo jest to standard przeznaczony dla systemów głośników i wydaje się, że taka opcja (słuchawki) funkcjonuje przede wszystkim z myślą o odbiorcach, którzy z różnych względów nie mogą odbierać materiałów inaczej, bądź taki właśnie jest ich wybór. Wynika to z faktu, że obecnie bardzo wiele osób nie tylko słucha muzyki, ale nawet ogląda filmy, transmisje sportowe i inne treści na urządzeniach mobilnych, jak tablety czy smartfony. A jak to wygląda od strony twórców? Realizacja materiału dźwiękowego w standardzie Dolby Atmos wymaga zastosowania dedykowanych narzędzi, jak specjalne wtyczki do lokalizacji przestrzennej czy dynamicznego panoramowania, a także możliwości renderowania finalnego mastera w odpowiedniej postaci. Także wymagania systemowe czy niezbędna moc obliczeniowa są oczywiście znacznie większe niż w przypadku realizacji stereofonicznych. Obecnie na rynku znajdziemy już szereg wtyczek kompatybilnych z większością hostów DAW, zatem od strony narzędzi jest w czym wybierać. Tym niemniej Dolby Atmos zdecydowanie zadomowił się na rynku filmowym (dla niego został w końcu stworzony) i wydaje się, że w zastosowaniach stricte muzycznych pozostanie marginesem, ciekawostką. Oczywiście, jest zagadnieniem, z którym muszą się mierzyć twórcy i realizatorzy muzyki filmowej, co jednak jest już tematem na osobny artykuł.

Oprogramowanie współpracujące z DAW przy renderowaniu masterów Dolby Atmos

360 Reality Audio

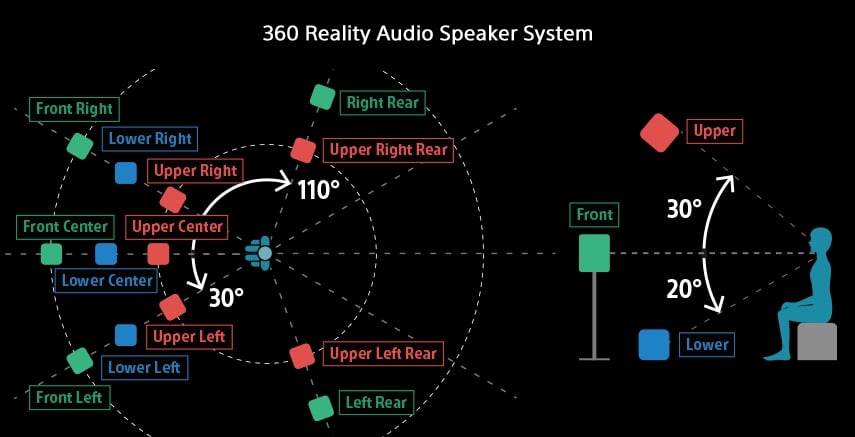

To stosunkowo nowy standard, opracowany i wprowadzony w 2019 roku przez firmę Sony (we współpracy z instytutem Fraunhofer IIS) i dość mocno przez nią promowany, także poprzez oferowanie optymalizowanych produktów konsumenckich, jak słuchawki, głośniki itp. W odróżnieniu od Dolby Atmos, przeznaczony jest zdecydowanie na rynek muzyczny i pojawił się już w niektórych serwisach streamingowych, jak choćby Deezer, Amazon Music Unlimited, TIDAL czy nugs.net, a także na YouTubie. Standard wykorzystuje technologię obiektowego dźwięku przestrzennego i bazuje na kodeku MPEG-H 3D Audio (stworzonym przez Fraunhofer IIS), który zdefiniowano w 2013 roku i pokazano w 2014 roku jako działający w czasie rzeczywistym enkoder audio. Jest to standard kodowania materiału dźwiękowego jak kanałów, obiektów czy też ambisonii wyższych rzędów – ze wsparciem do 64 kanałów projekcji audio. Nie będziemy się zbytnio zagłębiać w zagadnienia techniczne, bowiem najistotniejsze jest to, że 360 Reality Audio pozwala na dynamiczną lokację źródeł dźwięku (np. instrumentów) w trójwymiarowej, wirtualnej przestrzeni akustycznej (nazwijmy ją sferyczną). Technologia obiektowego dźwięku oznacza przy tym, że każdy nagrany dźwięk jest kodowany w taki sposób, że zawiera dodatkowe metadane określające pozycję tego źródła w przestrzeni, dzięki czemu system kompatybilny z tym standardem jest w stanie prawidłowo reprodukować materiał audio. I tu dochodzimy do kluczowego pytania o wymagania sprzętowe. 360 Reality Audio jest standardem opracowanym z myślą o słuchaniu muzyki (względnie oglądaniu materiałów wideo z takim dźwiękiem) w Internecie. W odróżnieniu od omówionego wcześniej binauralnego przeznaczony jest zarówno do odsłuchu w słuchawkach, jak i za pomocą głośników. Aczkolwiek obie te sytuacje stawiają zupełnie inne wymagania. O ile w przypadku słuchawek możemy wykorzystać dosłownie każde, to specyfikacja nowego standardu mówi już o głośnikach z nim kompatybilnych – Sony wymienia różne modele i ta lista stale rośnie. Z punktu widzenia odbiorcy indywidualnego, melomana, jest to zasadniczy problem, także dlatego, że do pełnego odbioru immersyjnego dźwięku 360 Reality Audio rekomenduje się odpowiednio skonfigurowany system 13 głośników. Oprócz frontowych lewego, prawego i centralnego, wymagane są takie same w postaci górnych i dolnych, a także cztery z tyłu, jako górne i dolne lewe/prawe. Ze słuchaczem zlokalizowanym, oczywiście, pośrodku. Biorąc pod uwagę warunki mieszkaniowe zdecydowanej większości osób, są to wymogi bardzo trudne do spełnienia, zwykle wręcz niemożliwe. Na marginesie – w tym konkretnym zastosowaniu nowy standard Sony jest konkurencyjny wobec Dolby Atmos (i równie wymagający). W materiałach firmowych można znaleźć grafiki pokazujące, że odsłuch możliwy jest także za pomocą systemu uproszczonego, stereo z dodanym kompatybilnym soundbarem. Daje to nieco poszerzoną bazę stereo i głębię, ale o immersyjnym dźwięku, sferycznej przestrzeni akustycznej nie ma mowy. Wydaje się zatem dość oczywiste, że większość odbiorców będzie doświadczać 360 Reality Audio w słuchawkach.

Rekomendowany system głośników do reprodukcji materiałów w standardzie 360 Reality Audio (grafika pochodzi z materiałów promocyjnych Sony)

Dla nas jednak najistotniejsze są kwestie związane z realizacją nagrań w tym standardzie czy też nowymi wymaganiami technicznymi. Przede wszystkim – nie ma możliwości prostej konwersji gotowego mastera (czy to wielokanałowego, czy tym bardziej stereo) na nowy format. Kreowanie takiego miksu wymaga wykorzystania dedykowanych narzędzi już od podstaw. Innymi słowy, jeśli naszym celem jest wyprodukowanie materiału w standardzie 360 Reality Audio, musimy posiadać wtyczkę umożliwiającą rozlokowanie poszczególnych źródeł dźwięku, instrumentów w sferycznej przestrzeni, a także zmiksowanie całego materiału. Sony rekomenduje 360 WalkMix Creator, dostępny w podstawowych formatach wtyczek i kompatybilny z większością popularnych hostów DAW. Jest to narzędzie do przestrzennej lokalizacji źródeł dźwięku (do 128 różnych, z możliwością automatyzacji), by były one prawidłowo reprodukowane u odbiorcy korzystającego ze słuchawek, czy też rekomendowanego systemu głośników. Ma także szereg innych funkcji pozwalających na uzyskanie immersyjnego dźwięku. Gotowy master w standardzie 360 Reality Audio jest renderowany w postaci szeregu plików WAV, które zawierają także metadane określające pozycję danego pliku. Wydaje się zatem, że wszystko jest w miarę jasne – standard jest zdefiniowany, wiemy jakie stawia wymagania techniczne i mamy narzędzie do realizacji finalnych masterów. Niestety, aż takie proste to nie jest.

Zrzut ekranu oprogramowania do tworzenia materiałów dźwiękowych w standardzie 360 Reality Audio

Jak już wspomniałem, 360 Reality Audio nie jest kompatybilny z żadnym innym standardem, a wynikowy materiał może być odtwarzany wyłącznie we właściwym środowisku – mówię tu o tym, jak rzecz wygląda od strony realizatora. Jeśli miks w omawianym standardzie jest jednym z oczekiwanych efektów, pracę producenta, realizatora trzeba od pewnego momentu rozdzielić na niezależne kierunki działania, każdy prowadzący do uzyskania innego materiału końcowego. Oczywiście, możliwe jest tworzenie wersji 360 Reality Audio nagrań istniejących wcześniej, ale trzeba cofnąć się do etapu pozycjonowania dźwięku w przestrzeni i miksowania całości. Jako elementy źródłowe wykorzystamy indywidualne ścieżki, względnie stemy – stosując odpowiednią wtyczkę (zapewne będzie się ich pojawiać coraz więcej) do ich lokalizacji, automatyzacji ruchu w przestrzeni itd. Zwracam uwagę na to, że niekompatybilność standardu z innymi powoduje, że aktualnie mamy zawężony wybór konkretnych narzędzi, a ew. posiadane wcześniej wtyczki do sferycznej lokalizacji/panoramowania mogą okazać się nieprzydatne. Słowem, jest to od pewnego etapu zupełnie inna praca nad miksem, stawiająca przed nami nowe wymagania. Także w kwestii studyjnych odsłuchów – w przypadku większych studiów dostosowanie się nie powinno stanowić problemu, w przypadku mniejszych czy wręcz domowych instalacja systemu 13 głośników i ich prawidłowe usytuowanie jest już dużym problemem. Pomocna jest funkcja monitoringu słuchawkowego (w czasie rzeczywistym dochodzi do konwersji na dźwięk dwukanałowy, zachowujący w słuchawkach właściwości akustyczne i pozycjonowanie), który pozwala na pracę w takich warunkach – tym niemniej musimy mieć świadomość, że jest to jednak zupełnie inny kontekst i wrażenia, a realizator powinien przecież wiedzieć, jak jego produkt zabrzmi w każdych warunkach. Ale dla twórców materiałów w standardzie 360 Reality Audio stanowi to pewną pomoc i można sobie wyobrazić pracę wyłącznie na słuchawkach – tym bardziej, że najprawdopodobniej ogromna większość odbiorców będzie w ten sposób odsłuchiwać finalny efekt.

Przykład przestrzennego pogłosu w postaci wtyczki – nr 1

Kolejnym problemem, zapewne wraz z upowszechnianiem się standardu zanikającym, jest niewielka liczba narzędzi do tworzenia kompatybilnych z nim miksów. Chodzi tu także o różne procesory efektowe, przede wszystkim zaś pogłosy. Bowiem do stworzenia realistycznie i prawidłowo brzmiącego dźwięku immersyjnego niezbędne jest zastosowanie odpowiedniego pogłosu – przestrzennego, trójwymiarowego. Od razu powiedzmy sobie, że pogłos stereofoniczny jedynie rozrzucony w wirtualnej przestrzeni sferycznej po prostu nie zabrzmi tak, jak powinien. To także będzie problemem w przypadku tworzenia wersji 360 Reality Audio ze zrealizowanego wcześniej materiału, zwłaszcza stereo. Zaleca się wówczas osobne lokowanie w przestrzeni samych źródeł dźwięku (suchych) i przypisanych do nich pogłosów. Choć tak na dobrą sprawę, te ostatnie powinno się zaprogramować od nowa. Rzecz w tym, że nadal ogromna większość produkcji muzycznych powstaje w postaci stereo – a zastosowanie w immersyjnych realizacjach pogłosów stereofonicznych (jest stosunkowo niewiele wielokanałowych, trójwymiarowych wtyczek tego typu) nie jest dobrym rozwiązaniem. Także tam, gdzie cały materiał jest pochodzenia mikrofonowego – zatem w nagraniach muzyki akustycznej, jak np. kameralnej, czy orkiestrowej – pogłos sali powinien być rejestrowany wielowymiarowo, a nie wyłącznie stereo. To są kwestie, z którymi realizatorzy nagrań (ale także sami kompozytorzy) będą musieli się zmierzyć, jeśli chcą poważnie myśleć o wykorzystaniu w swojej pracy 360 Reality Audio. Dużo też będzie zależało od przyszłości tego standardu, na ile upowszechni się on w serwisach streamingowych i jak przyjmą go sami odbiorcy. Ma wsparcie potężnej firmy i stale rośnie liczba dostępnych w nim utworów – czas pokaże, jaką zajmie pozycję na rynku. Wydaje się jednak, że docelowym segmentem będzie muzyka; w zastosowaniach filmowych, wideo wiodącą pozycję wywalczył Dolby Atmos. Wydaje się z kolei, że 360 Reality Audio jest w większym stopniu zorientowane na równouprawnienie odsłuchu w słuchawkach, który w przypadku Dolby Atmos jest czymś w rodzaju opcji budżetowej, podczas gdy głównym przeznaczeniem jest jednak system głośników.

Przykład przestrzennego pogłosu w postaci wtyczki – nr 2

Co nas czeka w przyszłości?

Próba odpowiedzi na tak postawione pytanie zawsze wiąże się z ryzykiem – rozminiemy się zasadniczo z tym, co tak naprawdę się wydarzy, źle ocenimy oczekiwania rynku czy też potencjał danej technologii. Tymczasem dla osób zajmujących się zawodowo muzyką, czy to kompozytorów, czy producentów i realizatorów, są to sprawy ważne, wiążące się choćby z inwestycją w określone narzędzia i wiedzę, jak z nich korzystać, by być na bieżąco i odpowiadać na zapotrzebowanie. Często też korzystają na tym ci, którzy najszybciej opanowali nową technologię i stali się cenionymi specjalistami. Z drugiej strony – historia technologii muzycznych zna przykłady bardzo obiecujących rozwiązań, oferujących doskonałą jakość, które z jakichś powodów się nie przyjęły i pozostały marginesem bądź w ogóle przeszły do historii. Wydaje się jednak, że bez większego ryzyka można założyć, iż tradycyjna stereofonia pozostanie dominującym standardem w branży muzycznej. Także w epoce serwisów streamingowych, cyfrowych wersji albumów i zanikających nośników fizycznych, które już dziś są produktem niszowym. Przytłaczająca większość materiałów dźwiękowych nadal będzie mieć taką postać, do której przyzwyczaili się odbiorcy, która nie stawia przed nimi wygórowanych wymagań sprzętowych i daje się słuchać zarówno przez głośniki, jak i w słuchawkach. Zapewne niezależnie od tego funkcjonować będą na rynku specjalne wersje tych nagrań w standardach opartych na technologii obiektowego dźwięku przestrzennego i oferujących wrażenie obcowania z trójwymiarową, otaczającą słuchacza przestrzenią akustyczną. Być może nawet będą się pojawiać materiały dostępne wyłącznie w takich postaciach – co zresztą incydentalnie dzieje się także dziś. Producenci czy wydawcy będą musieli liczyć się z oczekiwaniami i możliwościami odbiorców, dostarczając w miarę uniwersalnie zrealizowany materiał, który da się reprodukować w różnych warunkach. Który z omówionych w tym tekście standardów zdominuje rynek, czy może pojawią się kolejne – to się okaże. Jedno jest jednak pewne – warto opanować pracę w środowisku dźwięku immersyjnego, bo ma on przed sobą przyszłość i pozwala podnieść wrażenia artystyczne na jeszcze wyższy poziom.

Tekst: Dariusz Mazurowski, Muzyka i Technologia